中村研究室は,ひとに対する観察と,情報処理技術に対する理解をもとに,ひとが情報や様々なデバイスをお手玉するかのように,ひとと情報のインタラクティブシステムを実現することを目的としています.

中村研究室の研究プロジェクトは現在こんな感じです.

人の手書き文字・手描き図形の数理・認知科学的解明と応用

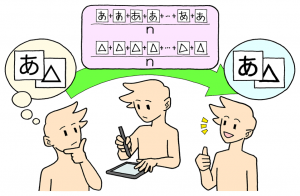

人の手書き文字や手描き図形はどのようなものなのか,ひとは頭のなかにある文字や図形をどのように再現しているのか,そして世の中の人の平均的な文字や図形はどういうものなのか,そしてその応用可能性について取り組んでいます.そのため,人の手書き文字や図形を数式として表現する手法を提案および実現しています.どのようにして手書き文字が数式表現化されているかについては,こちら(佐藤剣太君作)が参考になると思います.

理想と現実,そして平均

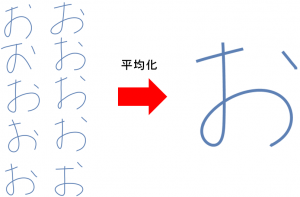

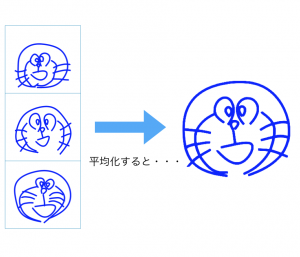

また,人の頭のなかの文字や図形はどうなっているのかを明らかにするため,平均手書き文字[中村2014],平均手描き図形[新納2015][新納2016]という研究に取り組んでいます.この研究のこれまでの成果により

- ひとの文字や図形を平均化すると綺麗であると評価される

- いろいろなひとの文字や図形を平均化したものは,個人の平均より綺麗であると評価される

- どんなに字にコンプレックスがあっても自身の文字は好む傾向が高い

- 利き手と非利き手により生成されるものは似ている

- ひとは自身の文字を他者の文字から識別可能で,それは字がきれいな人ほど識別能力が高い.また,書きなれている名前での手書きの識別能力は高く,他者の手書きと融合されてもある程度識別可能である [斉藤2016]

ということを明らかにしてきました.例えば複数人の平均化は下記のような感じになります.

この様々な特性について,現在も色々な実験を行うことによって,ひとの手書きとは何なのかについて迫ろうとしています.

また,その応用として下記のような研究も行っています.

- 文字アニメーションを手軽に生成する手法 [佐藤2015][佐藤2016]

- 練習におけるモチベーションを保つことを可能とする研究 [久保田2016]

- 平均化によるきれいに描画可能なドローイングシステム [新納2016]

- など

音楽動画の印象探索を可能とする印象推定に関する研究

「悲しい気分なので泣ける動画を探したい」「イライラしているので大笑いできる動画を探したい」などのように,動画(ここでは音楽と映像がミックスされているものを特に音楽動画と呼んでいます)を自身の思い浮かべた印象で検索・探索したいというニーズがあります.また,検索・探索のみならず,現在視聴している音楽動画と類似した印象の音楽動画を,またはまったく類似していない音楽動画を視聴したいと望むときに,印象に基づく推薦が求められています.そうしたユーザのニーズを満たすために,音楽動画の印象はどのようにしたら精度高く推定できるかについて研究をしています.

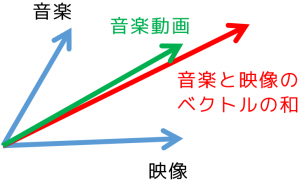

ここでは特に,そもそも音楽動画(音楽と映像がミックスされたもの)の印象は,音楽単体の印象と映像単体の印象をどのように組み合わせて表現されるのかということを明らかにするため,音楽のみ映像のみ,音楽と映像ミックスしたもののサビ部分に対する印象評価データセットを500曲分構築し,そのデータセットを利用して印象評価がどう組み合わせられるかについて取り組み[大野2015][大野2016],質の高い音楽動画において音楽と映像の印象はそれぞれ足し合わせた形で高めあう傾向が高いことや,適当に音楽と映像を組み合わせる場合は,音楽が印象を決めることが多いため,音楽をより考慮したことがよいことなどを明らかにしてきました.

また,音楽動画に対して投稿されたソーシャルコメントから,音楽のみ映像のみの印象をどの程度推定可能かということについても研究しており[土屋2015][土屋2016],メディアのタイプによって印象推定精度が異なること,印象軸によって推定に有効な品詞が異なることなどを明らかにしてきています.この研究の発展で,現在音楽自体の特徴量,映像自体の特徴量などについても分析し,その印象評価を組み合わせる手法について取り組んでいます.

さらに,このコメントからの印象推定を利用した音楽動画のサムネイル動画自動生成(15秒程度のサムネイル動画の生成)に関する研究[前島2016]や,その他の応用についても取り組んでいます.

コンテンツ装飾に関する研究

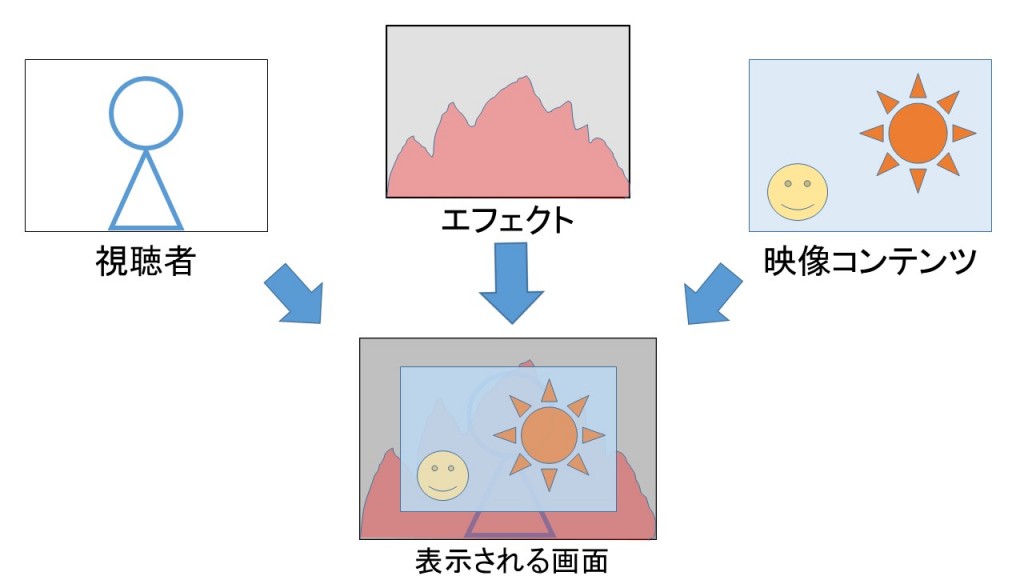

ウェブ上に存在する膨大な画像や動画を閲覧・視聴するのは,それだけで楽しいものですが,もっと自分っぽく楽しくしたい,もっと感情豊かにしたい,もっとわかりやすくしたいといったニーズはあるものです.これは,ご飯を食べに行ったときに,もう少し自分の味にしたいと,七味や胡椒などの調味料を足すのに似ています.

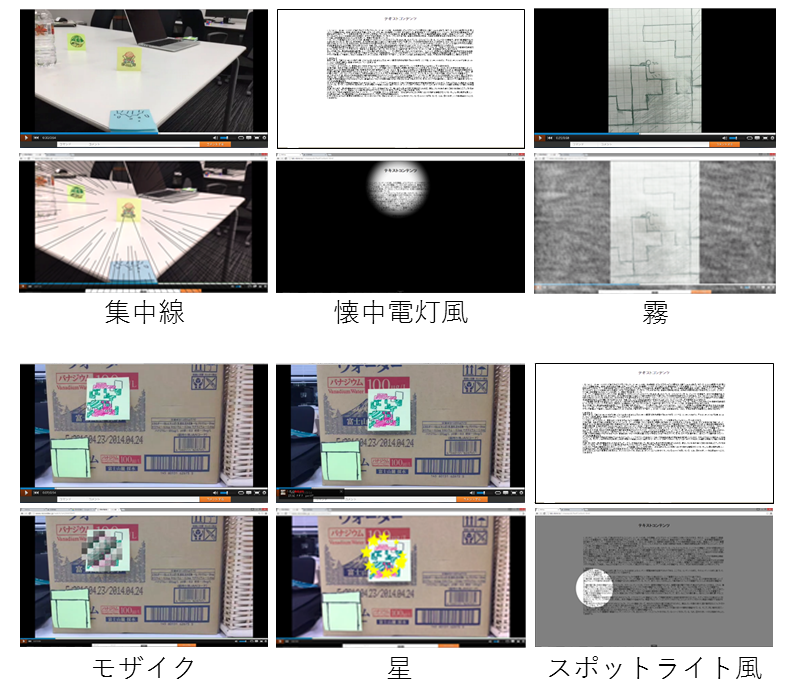

我々はこれをコンテンツ装飾と呼んでおり,ウェブ上の任意の画像や映像に対して,上に装飾を付与するフィルタを同時提示する手法を実現しています.

これまでの研究では

これまでの研究では

などを実現しています.このシステムについては,Decobyという名前でChrome拡張として配布していますので,ご興味のある方はお試しいただければと思います.なお,この研究を発展させて便利に使える手法などについても研究に取り組んでいます.

視線や体の動きを利用した視聴体験拡張に関する研究

ひとの視線は様々な特性を持っており,視線の先を中心とした中心視,そしてその周辺としてぼんやり見えている周辺視があります.このひとの視線の動きを活かしたり,周辺に何らかのエフェクトを提示することによって動画などの視聴体験を拡張する研究を実施しています.

これまでの研究では

- ひとの視線に追随する形で集中線や懐中電灯風のエフェクトを提示することによって,スピード感などを増幅する研究 [田村2015][田村2016]

- 視線に追随する形で中心視以外をぼかすことによって,迫力や立体感などを増幅させる研究 [山浦2016]

- 動画の周辺にエフェクトを提示し,周辺視部分を刺激することによって焦りなどを強調し動画の印象を変化させる研究 [松井2015][松井2016]

- 動画の周辺に錯視図形を提示し,周辺視部分を刺激することによって動画の視聴体験を拡張する研究 [福地2016]

などの研究に取り組んでおり,システムを実装して実験することによりそれぞれその有用性を示しています.現在は,こうした視線の動きや周辺視の特徴を利用した研究に取り組んでいます.

また,視線以外としてひとが映像の中に入り込むことを可能にすることによりコンテンツの体験を拡張するVRMixerの応用研究[牧2015]についても取り組んでいます.

ネタバレ防止に関する研究

ネタバレというのはそのコンテンツを楽しもうとしているひとにとっては大きな問題であり,ネタバレによってコンテンツを視聴・閲覧する気がなくなったり,喧嘩になってしまったりといったことは珍しくありません.我々は,こうしたネタバレをいかに防ぐかという点に注目して,研究に取り組んでいます.

これまでは,我々はまずそもそもシステムが完璧にネタバレを判定することが難しく,ひとはすぐにネタバレに気づいてしまうという問題に着目し,システムが完璧にネタバレを判定できないときのユーザインタフェース的な仕組み(ごみを混入させたり,結果をあいまいに反転させるなど)を実現し,論文化しました.

また続きの研究として,Twitter上でのスポーツのネタバレはどういうものなのかということを,直接的なネタバレ・間接的なネタバレと分類してその特性を分析し[白鳥2015],システムが試合展開を把握しながら識別器を切り替えることによって特に判定の難しい間接的なネタバレを判定する手法[白鳥2016]を提案してきました.

さらに,Twitter上でのアニメのネタバレについても,その地域に応じた放送時間差によって日本ではアニメのネタバレでどういった問題が生じるのかを明らかにするとともに[田島2015],SVMで判定する手法を実現してコンテンツによるネタバレの判定難易度について明らかにしています[田島2016].

ユーザインタフェースの失敗学に関する研究

BADUI(Bad User Interface)については「失敗から学ぶユーザインタフェース」という本や,楽しいBADUIの世界,BADUIタレこみサイトなどにまとめていますが,この失敗してしまうユーザインタフェースを何とかするための研究や,応用していく研究,その分類学に関する研究などについて取り組んでいます.

そのうちの1つが,ウェブ上の説明が不十分でわかりにくい画像に対してマウスカーソルの動きや人の動きといったアニメーションを重畳することによって,理解度を向上させるというものです[樋川2016].また,それ以外にもウェブ上のフォームに対して機能を埋め込むことによって間違いをなくす方法などにも取り組んでいます.