はじめに

中村研究室修士1年の徳原眞彩です。

2026年3月9日〜11日に芝浦工業大学豊洲キャンパスにて開催された第217回ヒューマンコンピュータインタラクション研究会(HCI)にて研究発表を行いましたので、ご報告させていただきます。

今回は「Webページ上の要素がもつクリック可能性に対する人間による認知とVLMによる認識の一致度調査」というタイトルで発表してきました。

研究概要

我々はこれまでの研究で、Webページ上の「クリックできなさそうな見た目でありながら、実際にはクリックすることができる要素」をユーザに提示するシステムの提案を行ってきました。本研究は昨年のこちらの研究の続きとなっておりますので、詳細な背景等は先のリンクをご覧ください。

このシステムでは、クリックできなさそうな見た目の要素を抽出するためにVLM(Vision-Language Model)を活用しています。VLMは画像とテキストの両方を理解できるAIモデルですが、人間と同じように、ユーザを惑わせるような分かりづらい・使いにくいUIに遭遇すると、判断を間違えてしまうという特性を持っているという知見があります。

私たちはこの特性を利用し、「プログラム上はクリック可能であるにもかかわらず、VLMが『クリック可能である』と推測できなかった要素は、人間にとっても直感的に認知するのが難しい要素である」と考えました。この仮定に基づき、そうした見落とされがちな要素をAIの誤認を利用して検出し、ユーザにハイライト等で強調表示して提示する仕組みを構築しました。

しかし、この提案システムで利用しているVLMの認識特性が、人間の実際の振る舞いとどの程度合致しているか、あるいはどのように異なるのかについてはこれまで十分に検証できていませんでした。

そこで本研究では、Webページ上のクリック要素に対する人間とVLMの認識結果を詳細に比較・分析することで、VLMの認識特性が人間の直感的な認知とどの程度合致あるいは乖離しているかを明らかにし、UI検出においてVLMを利用することの有効性とその限界について議論を行いました。

調査と評価

調査には、日本全国の各市区町村の公式ホームページから収集した1,000枚のスクリーンショットを用いました。これらの画像に対して、学生4名(人間)とVLMのそれぞれに「ページ遷移が発生すると直感的に判断できる要素(クリック可能要素)」を抽出してもらい、その結果を比較しました。

比較の結果、VLMが検出した要素の多くは人間にとっても妥当であり、VLMが人間よりも過剰にクリック可能と判断してしまう割合を示す適合率は0.977という精度を示しました。これにより、システムが本来提示すべきな要素を除外してしまうリスクは実利用できる範囲に抑えられていることがわかりました。

一方で、人間とVLMの認知に違いがあることも明らかになりました。

-

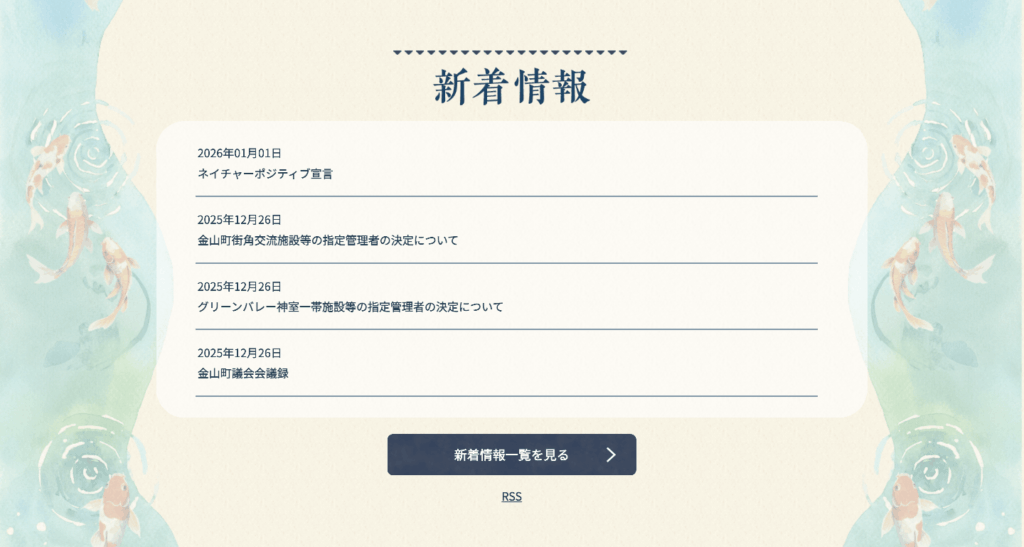

視覚的特徴の乏しいテキストリンクの見落とし:下線や枠線といったクリックを誘発する視覚的な手がかりがないテキストの場合、人間は「新着情報の一覧を見る」などの文脈からリンクだと判断できても、VLMは見落としてしまう傾向がありました。(下の画像の「ネイチャーポジティブ宣言」や「金山町街角交流施設等の指定管理者の決定について」などの部分)

-

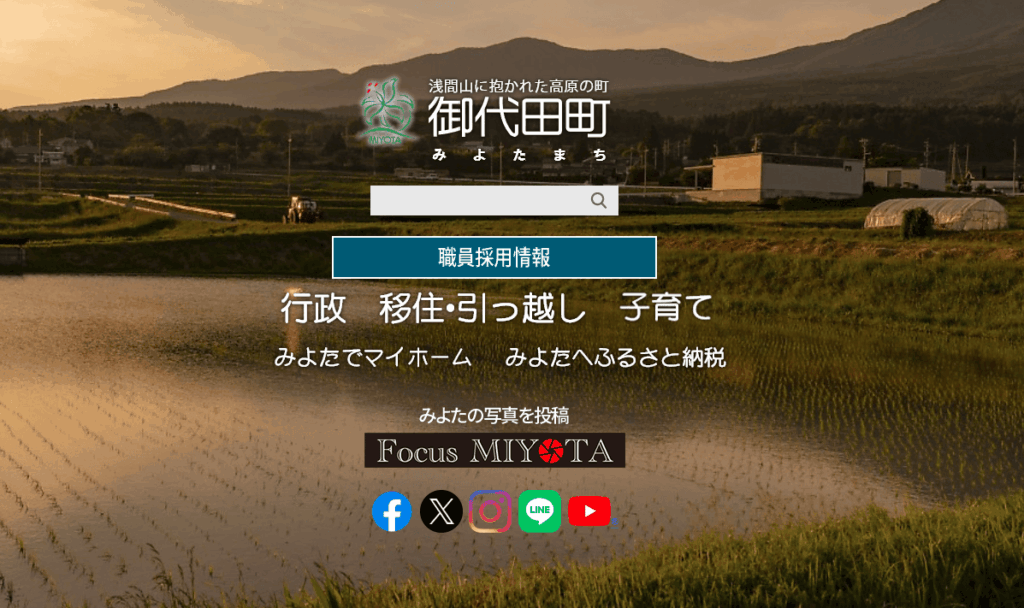

文脈理解による過剰な検出:逆に、背景写真と同化してしまっているような白文字のリンクなど、人間が視覚的な手がかりのなさから見落としてしまった要素に対して、VLMは「自治体サイトにおけるメニュー項目だろう」というテキストの意味的文脈から正確に推論し、過剰に検出してしまうケースが見られました。(下の画像の「行政」や「移住・引っ越し」などの白文字で書かれた部分)

このように、VLMの持つ文脈理解能力が、かえって人間のような「純粋な見た目による直感的な評価」を阻害してしまう要因になり得ることが示唆されました。

今後

VLMを人間の視覚的認知のシミュレータとしてより有効に活用するためには、VLMが持つ知識レベルや意味的理解を制御するかが重要な課題となります。

今後は、VLMに入力する画像にあえて低解像度化やぼかし処理を施すことで、文字などの意味的な情報の読み取りを制限し、より人間の直感的な視認性に近づけるようなアプローチを検討していく予定です。

発表スライドと論文情報

論文情報

おわりに

修士課程に進学してからも引き続きこのテーマを深掘りし、こうして発表の機会をいただけたことを嬉しく思います。質疑応答では、本分野に近い研究をされている先生方から今後の参考になる貴重なご意見をいただけました。ありがとうございました。

最後に、論文執筆や発表練習に何度もご指導いただいた中村先生や研究室の皆様に心より感謝申し上げます。